Forbes México.

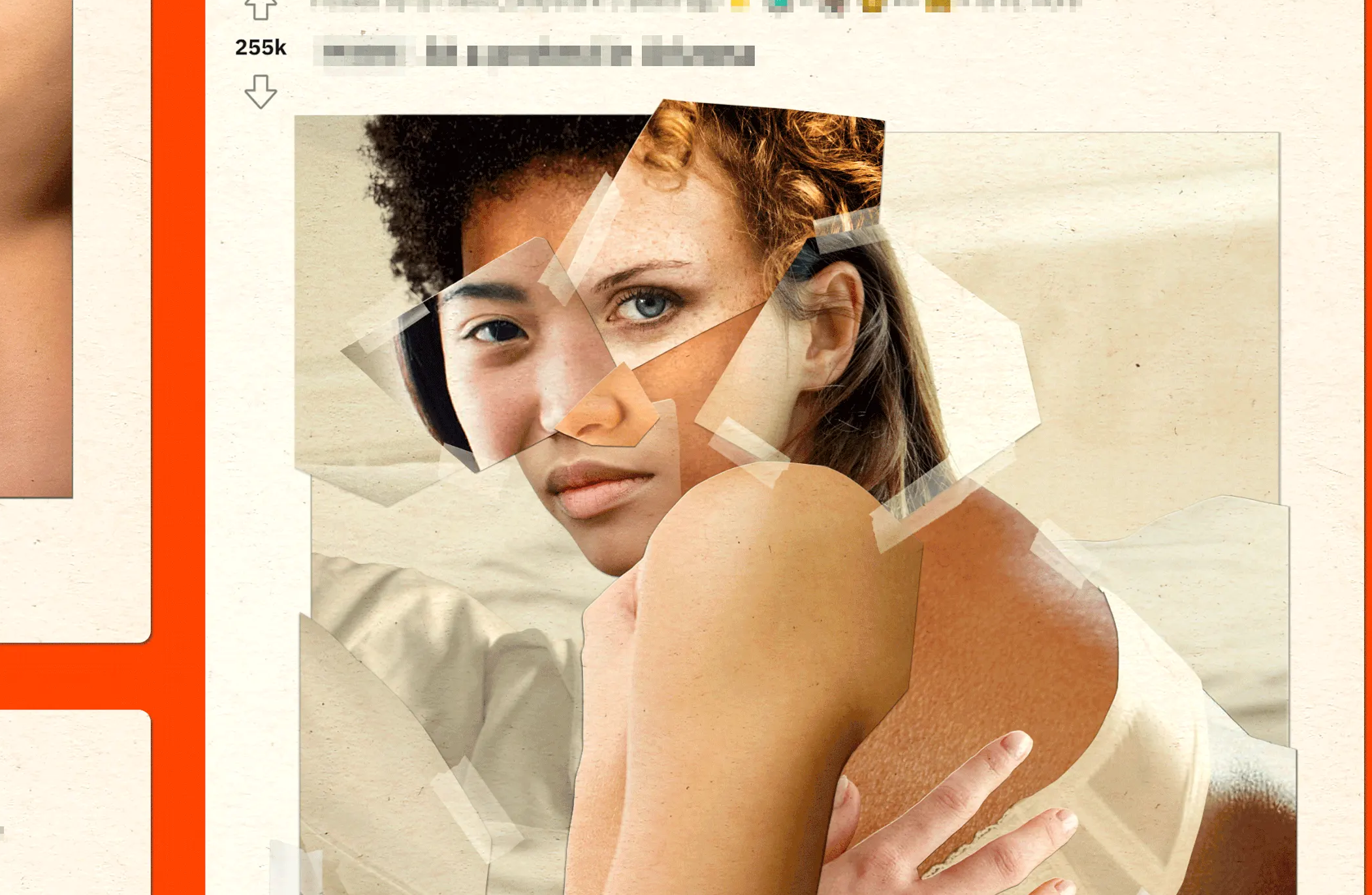

Así es cómo la gente real se ve atrapada en la explosión pornográfica de IA de Reddit

Reddit ha sido durante mucho tiempo un almacén de pornografía, que permite en su plataforma siempre que sea consensual.

Ahora, a medida que las herramientas de IA de texto a imagen se ponen de moda, una avalancha de imágenes pornográficas generadas por IA ha descendido sobre Reddit, a la que pueden acceder sus 57 millones de usuarios activos.

Si bien estas imágenes pueden ser falsas, los modelos utilizados para crearlas están entrenados con fotos de personas reales y pueden reproducir facsímiles de ellas, en su mayoría sin su consentimiento, dijeron los expertos a Forbes.

“El problema fundamental de la pornografía generativa con IA es que se basa en el robo a gran escala de imágenes y semejanzas de personas, y de manera desproporcionada de mujeres”, dijo Noelle Martin, sobreviviente de falsificaciones sexuales profundas e investigadora legal en la Universidad de Australia Occidental.

Forbes encontró 14 subreddits dedicados a la pornografía generada por IA, 10 de los cuales se crearon en los últimos dos meses.

Cada subreddit tiene miles de miembros y miles de visitas cada semana. Uno de los subreddits de pornografía de IA más populares es r/unstable_diffusion, que ha estado activo desde septiembre de 2022 y tiene 54,000 miembros.

Otro tiene más de 60,000 miembros. Reddit tiene un conmutador para “búsqueda segura” para ocultar contenido para adultos durante la búsqueda normal, pero sin este conmutador, la búsqueda de “pornografía de IA” en Reddit arroja más de dos docenas de foros que alojan y comparten material para adultos generado por IA.

Dentro de estos subreddits, algunos usuarios solicitan o venden deepfakes sexuales generados por IA de personas reales.

En “crear contenido nuevo con mi imagen para distribuir y entrenar los sistemas de IA, básicamente significa que yo, como persona, no tengo control ni capacidad para detenerlo”.

Una víctima del tráfico sexual

A medida que las herramientas de IA de texto a imagen se vuelven más sofisticadas y sus resultados más realistas, se hace más difícil para los usuarios diferenciar no solo entre lo que es real y lo que no, sino también lo que es consensuado y lo que no lo es.

A principios de abril, se engañó a algunos usuarios de Reddit para que pagaran 100 dólares por las fotos de una mujer de 19 años llamada Claudia, que se hicieron con la herramienta de inteligencia artificial Stable Diffusion, según Rolling Stone.

Los expertos dicen que los sistemas de texto a imagen del tipo que idean la pornografía de IA se entrenan con millones de imágenes de personas reales, en su mayoría sin su conocimiento o consentimiento, así como con imágenes propiedad de otras entidades.

Artistas y plataformas de imágenes de stock como Getty han demandado recientemente a generadores de texto a imagen de IA como Stability AI y Midjourney por infracción de derechos de autor.

Una víctima de un caso de tráfico sexual en el que ella y otras mujeres fueron obligadas a tener relaciones sexuales frente a la cámara, le dijo a Forbes que cree que el uso de sus imágenes o videos para entrenar sistemas de IA sería una violación de su privacidad.

La víctima, que habló de forma anónima con Forbes porque le preocupaba que volvieran a aparecer videos de ella, dice que los videos sexualmente explícitos de ella se subieron a Reddit y otros sitios sin su consentimiento y luego se eliminaron.

“Que la gente todavía tenga copias de esto ya es una gran infracción de mis derechos legales”, dice. “Entonces, para que compartan estas copias públicamente y luego creen contenido nuevo con mi imagen para distribuir y entrenar los sistemas de inteligencia artificial, básicamente significa que yo, como persona, no tengo control ni capacidad para detenerlo”.

La pornografía generada por IA también ha aparecido en otras plataformas como Twitter e Instagram. Pero ha florecido predominantemente en Reddit, en parte porque la plataforma permite a los usuarios permanecer en el anonimato y no les prohíbe compartir contenido sexualmente explícito.

Lee más: Los economistas más influyentes de México 2023: el modelo económico que el país necesita

Así es cómo la gente real se ve atrapada en la explosión pornográfica de IA de Reddit

La plataforma también se ha utilizado para entrenar modelos de lenguaje grandes y ahora exige un pago: el CEO de Reddit, Steve Huffman, dijo en una entrevista reciente con el New York Times que quiere que Google, Microsoft y OpenAI paguen por usar los datos y las conversaciones de Reddit. para entrenar sus algoritmos. “El corpus de datos de Reddit es realmente valioso. Pero no necesitamos dar todo ese valor a algunas de las empresas más grandes del mundo de forma gratuita”, dijo Huffman al New York Times.

Reddit anunció recientemente que cerrará su API de datos, que había estado abierta desde 2008, y planea cobrar a terceros más grandes por el “acceso premium”.

Con el respaldo de pesos pesados como Andreessen Horowitz y Sequoia Capital, Reddit se valoró por última vez en 10,000

millones de dólares después de recaudar 700 millones en una ronda de la Serie F en agosto de 2021. Con 1,900 millones en financiamiento total, también planea cotizar en bolsa en 2023.

Reddit registró 470 millones en ingresos en 2021 principalmente a través de ventas de anuncios y suscripciones premium, según estimaciones de Statista.

“Siento que con Reddit, puedes empujar un poco el sobre con lo queEs aceptable de una manera que no es posible en otras plataformas”.

Sophie Maddocks, investigadora sobre ciberviolencia sexual

Si bien Reddit afirma no mostrar anuncios ni monetizar contenido para adultos en su sitio, los expertos dicen que permitir contenido para adultos en el sitio, artificial o real, atrae a más usuarios a la plataforma e impulsa la participación. “Aunque no se anuncian en los subreddits, aún se benefician del hecho de que estos hilos atraen a mucha gente”, dice Sophie Maddocks, investigadora sobre violencia sexual cibernética.

Los usuarios que acuden a la plataforma para consumir pornografía también visitan otras páginas y subreddits que no contienen contenido NSFW, dice Jamie Cohen, profesor de redes sociales y estética publicitaria en la universidad CUNY Queens. “Reddit en realidad rastrea las visitas a la página y las visitas a subreddit y luego envía datos personalizados que ofrecen nuevas vías para que los anunciantes los utilicen”, dice.

Si bien Reddit es la plataforma de redes sociales más grande que alberga pornografía de IA para sus decenas de millones de usuarios, una serie de sitios específicos de pornografía de IA se han establecido para monetizarla.

La mayoría de los generadores de pornografía de IA como PornJourney, PornPen, PornJoy y SoulGen cobran suscripciones premium y están conectados a cuentas ocultas de Discord o Patreon administradas por usuarios anónimos.

Sus sitios web muestran una variedad de pornografía generada por IA con diferentes opciones para etnias y tipos de cuerpo e instrucciones sobre cómo crearlos, todo con poca o ninguna divulgación de cómo se entrenaron los sistemas y en qué imágenes.

Con ese fin, los sitios también incluyen descargos de responsabilidad sobre el contenido generado a través de sus herramientas: “Cualquier generación de contenido en este sitio web que se parezca a personas reales es pura coincidencia. Esta IA refleja sesgos y conceptos erróneos que están presentes en sus datos de entrenamiento”.

Uno de esos generadores de imágenes de IA, PornJourney, se creó y lanzó en marzo de 2023; cobra a los usuarios 15 por mes para crear “chicas AI” que se ven “reales y como humanos”, según su sitio web.

“Proporcionar fotos auténticas y detalladas de niñas con IA es costoso, lo que nos obliga a invertir continuamente en nuestros servidores”, explica la sección de preguntas frecuentes del sitio.

PornPen, que tiene 2 millones de usuarios mensuales y 12,000 usuarios que pagan 15 dólares por mes por su herramienta de generación de pornografía con IA, se basa en el modelo de IA de Stable Diffusion y obtiene imágenes de un conjunto de datos llamado “LAION”, que contiene aproximadamente 6,000 millones de imágenes obtenidas de sitios disponibles públicamente.

El conjunto de datos masivo incluye imágenes de celebridades, modelos, políticos y creadores de contenido. El sitio web de la organización sin fines de lucro dice: “Nuestra recomendación es utilizar el conjunto de datos con fines de investigación”.

Tori Rousay, gerente de defensa del Centro Nacional sobre Explotación Sexual (NCOSE, por sus siglas en inglés), dice que la mayoría de los generadores de texto a imagen pornográficos de IA como Unstable Diffusion y Porn Pen usan modelos de código abierto de GitHub o Hugging Face para extraer imágenes de sitios web pornográficos y perfiles de redes sociales y construir una base de datos de imágenes sexualmente explícitas.

Forbes encontró al menos cinco repositorios de GitHub para rastreadores web que se pueden usar para extraer imágenes y videos de sitios web como PornHub y Xvideos, así como sitios de redes sociales como Twitter, Instagram y TikTok para construir sistemas de IA. PornHub y Xvideos no respondieron a una solicitud de comentarios.

“Unstable Diffusion es como el primo de Stable Diffusion. Entonces, lo que hicieron fue tomar su código, lo replicaron y crearon su propio repositorio basado solo en imágenes pornográficas y de desnudos”, dice Rousay, quien investigó cómo se usa la IA para hacer pornografía.

Las celebridades femeninas, las políticas y las periodistas tienen más probabilidades de ser víctimas de la pornografía artificial porque una gran cantidad de su contenido visual está disponible en línea, dice Rousay. Estos individuos también son los más buscados en la creación de deepfakes.

Reddit ha tratado de aclarar su postura sobre esta área emergente de contenido sexualmente explícito al prohibir el contenido sexualmente explícito no consensuado, incluidas las “representaciones que han sido falsificadas”, en referencia a las falsificaciones profundas de IA, cuando un algoritmo genera imágenes falsas de una persona real.

El sitio también prohíbe el “material generado por IA si se presenta en un contexto engañoso”, según un portavoz de Reddit. Reddit dice que utiliza una combinación de herramientas automatizadas y su equipo de seguridad interno para detectar y eliminar contenido explícito no consentido del sitio. Pero no capta todo.

“Reddit también es conocido por tener esas líneas borrosas entre lo que es moralmente cuestionable y lo que está prohibido en Reddit. Entonces, la pornografía generada por IA cae dentro de la zona gris de Reddit”, dice Rousay.

Deepfakes, contenido sexual explícito no consensuado y pornografía generativa de IA existen en el mismo grupo de imágenes pornográficas que se reciclan en nuevas imágenes de IA. Pero es importante tener en cuenta la diferencia entre la pornografía generativa de IA, que representa a una persona no identificable completamente nueva, y las falsificaciones sexuales profundas, donde las caras de las personas se cosen digitalmente en los cuerpos de otras personas.

La investigadora y sobreviviente de deepfake Martin dice que se enfrentó a tLas implicaciones de esto hace 10 años, mucho antes de que existiera la IA generativa, cuando alguien modificó con Photoshop sus selfies para fabricar imágenes y videos pornográficos de ella. Con los avances tecnológicos de los últimos años, cada vez es más difícil diferenciar las falsificaciones sexuales profundas de la pornografía de IA, dice.

“Reddit es conocido por tener esas líneas borrosas entre lo que es moralmente cuestionable y lo que está prohibido en Reddit”.

Tori Rousay, gerente de defensa del Centro Nacional sobre Explotación Sexual

Nicola Henry, que ha estado estudiando la violencia sexual facilitada por la tecnología y el abuso sexual basado en imágenes durante 20 años en el Royal Melbourne Institute of Technology, dice que, en comparación con las falsificaciones sexuales profundas, la pornografía artificial puede parecer más inocua a primera vista.

Pero al mirar más de cerca, algunas imágenes muestran rastros de que la IA puede estar entrenada en imágenes de menores, dice ella. “He visto algunas de las imágenes de IA en Reddit y las caras no parecen mujeres sino niñas menores de edad, por lo que es preocupante porque si fueran reales, esas imágenes podrían calificar como contenido de abuso sexual infantil”.

El fabricante de pornografía con IA Unstable Diffusion ha intentado eludir este problema prohibiendo a los usuarios usar su herramienta para crear MASI y tratando de obtener imágenes consensuadas pidiéndoles a las personas que las proporcionen a cambio de acceso anticipado y membresía gratuita a su generador de pornografía con IA. Ahora, afirma haber recopilado 15 millones de imágenes “donadas por usuarios” para su base de datos de capacitación.

Maddocks dice que incluso si estas herramientas se utilizan para la expresión y exploración sexual, fomentan expectativas poco realistas y poco saludables en torno a la imagen corporal y las relaciones sexuales simplemente por el corpus de datos del que se alimentan.

Navegando a través de la erótica generativa de IA en Reddit y Twitter, dice que estas representaciones reflejan estereotipos sexuales y prejuicios raciales que se encuentran en los principales medios de comunicación. “Debido a que estas herramientas están aprendiendo de las imágenes que ya existen, o del texto que ya existe, cuando les pides que produzcan muchas imágenes de grupos sexuales marginados o de personas de color queer o trans, a menudo surgen. corto”, dice ella.

Los sistemas de IA que remezclan contenido de sitios como PornHub y Xvideos plantean un problema adicional para los actores adultos que poseen los derechos de su contenido, dice Maddocks.

Los actores de películas para adultos y las plataformas que alojan su trabajo ganan dinero con las suscripciones y la publicidad en su contenido, dice.

Pero hasta el momento, no se les paga si sus imágenes se usan para generar pornografía. Los artistas y las plataformas que han sufrido pérdidas financieras por la IA generativa han tomado medidas contra las herramientas de IA como Stable Diffusion por usar imágenes sin pagar.

La pornografía generativa con IA podría provocar una protesta similar en la industria del cine para adultos, dice Maddocks.

Reddit históricamente ha acomodado varias otras formas de contenido sexualmente explícito y sexualmente abusivo dentro de sus comunidades.

Años después de que se eliminaran subreddits controvertidos como r/jailbait y r/creepshots, las imágenes sexualmente explícitas de comunidades prohibidas aún permanecen en la plataforma. “Siento que con Reddit, puedes ir un poco más allá con lo que es aceptable de una manera que no puedes en otras plataformas”, dice Maddock, y “estás completamente fuera del radar”.

Este artículo fue publicado originalmente en Forbes US.

Te puede interesar: México y Houston pactan estrategia para promover el turismo en ambos destinos

Así es cómo la gente real se ve atrapada en la explosión pornográfica de IA de Reddit

Forbes Staff

This content was originally published here.

VOTA PARA EVITAR LA DICTADURA

SALVA Al EDOMEX, UNIDOS SOMOS MAYORÍA

TENEMOS SOLO UNA OPORTUNIDAD

EL 4 DE JUNIO DEL 2023 VOTA PARA MANTENER

TU LIBERTAD, LA DEMOCRACIA Y EL RESPETO A LA CONSTITUCIÓN.

SI NO VOTAS PROBABLEMENTE TU VOTO NO VOLVERÁ A CONTAR

UBICA TU CASILLA AQUÍ

EL 2 DE JUNIO DEL 2024 VOTA PARA MANTENER

TU LIBERTAD, LA DEMOCRACIA Y EL RESPETO A LA CONSTITUCIÓN.

VOTA POR XÓCHITL

Comentarios